Após a operação militar dos EUA na Venezuela que levou à destituição do seu líder, Nicolás Maduro, vídeos gerados por IA que pretendem mostrar cidadãos venezuelanos a celebrar nas ruas tornaram-se virais nas redes sociais.

Esses clipes de inteligência synthetic, retratando multidões alegres, acumularam milhões de visualizações nas principais plataformas como TikTok, Instagram e X.

Um dos primeiros e mais amplamente compartilhados clipes no X foi postado por uma conta chamada “Wall Avenue Apes”, que tem mais de 1 milhão de seguidores na plataforma.

O publicar retrata uma série de cidadãos venezuelanos chorando de alegria e agradecendo aos EUA e ao presidente Donald Trump por removerem Maduro.

Desde então, o vídeo foi sinalizado por uma nota da comunidade, um recurso de verificação de fatos de crowdsourcing no X que permite aos usuários adicionar contexto a postagens que eles acreditam serem enganosas. A nota dizia: “Este vídeo é gerado por IA e atualmente está sendo apresentado como uma declaração factual destinada a enganar as pessoas”.

O clipe foi visto mais de 5,6 milhões de vezes e compartilhado de novo por pelo menos 38.000 contas, inclusive pelo magnata dos negócios Elon Musk, antes de ele finalmente remover a postagem.

A CNBC não conseguiu confirmar a origem do vídeo, embora os verificadores de fatos da BBC e da AFP tenham afirmado que a versão mais antiga conhecida do clipe apareceu na conta do TikTok. @curiosomindusaque publica regularmente conteúdo gerado por IA.

Mesmo antes de esses vídeos aparecerem, Imagens geradas por IA mostrando Maduro sob custódia dos EUA foram circulando antes de a administração Trump divulgar uma imagem autêntica do líder capturado.

O presidente venezuelano deposto foi capturado em 3 de janeiro de 2026, depois de as forças dos EUA terem conduzido ataques aéreos e um ataque terrestre, uma operação que dominou as manchetes globais no início do novo ano.

Junto com os vídeos gerados por IA, o Equipe de verificação de fatos da AFP também sinalizou uma série de exemplos de conteúdo enganoso sobre a derrubada de Maduro, incluindo imagens de celebrações no Chile apresentadas falsamente como cenas da Venezuela.

A desinformação proveniente de grandes eventos noticiosos não é nova. Conteúdos falsos ou enganosos semelhantes circularam durante os conflitos Israel-Palestina e Rússia-Ucrânia.

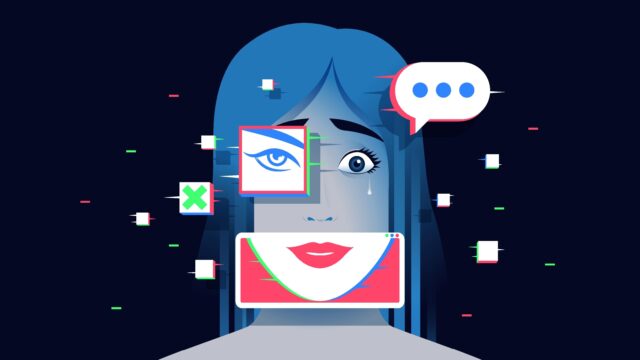

No entanto, o enorme alcance e o realismo dos conteúdos gerados pela IA relacionados com os desenvolvimentos recentes na Venezuela são exemplos claros de como a IA está a avançar como uma ferramenta para a desinformação.

Plataformas como Sora e Midjourney tornaram mais fácil do que nunca a geração rápida de vídeos hiper-realistas e passá-los como genuínos no caos de eventos de última hora. Os criadores desse conteúdo procuram muitas vezes amplificar certas narrativas políticas ou semear confusão entre o público world.

No ano passado, vídeos gerados por IA de mulheres reclamando da perda de seus benefícios do Programa de Assistência Nutricional Suplementar, ou SNAP, durante uma paralisação do governo também se tornaram virais. Um desses vídeos gerados por IA enganou a Fox Information, que apresentado isso como actual em um artigo que foi posteriormente removido.

À luz destas tendências, as empresas de redes sociais têm enfrentado uma pressão crescente para intensificar os esforços para rotular conteúdos de IA potencialmente enganosos.

No ano passado, o governo da Índia proposto uma lei que exige essa rotulagem, enquanto a Espanha aprovado multas de até 35 milhões de euros por materiais de IA não rotulados.

Para responder às preocupações crescentes, as principais plataformas, incluindo TikTok e Meta, lançaram ferramentas de detecção e rotulagem de IA, embora os resultados pareçam mistos.

A CNBC conseguiu identificar alguns vídeos no TikTok apresentados como celebrações na Venezuela que foram rotuladas como geradas por IA.

No caso do X, a plataforma confiou principalmente nas notas da comunidade para rotular o conteúdo, um sistema que os críticos dizem que muitas vezes reage muito lentamente para evitar que a desinformação sobre IA se espalhe antes de ser identificada.

Adam Mosseri, que supervisiona o Instagram e o Threads, reconheceu o desafio enfrentado pelas mídias sociais em um recente publicar. “Todas as principais plataformas farão um bom trabalho na identificação de conteúdo de IA, mas irão piorar com o tempo, à medida que a IA melhorar na imitação da realidade”, disse ele.

“Já existe um número crescente de pessoas que acreditam, como eu, que será mais prático obter impressões digitais de meios de comunicação reais do que de meios falsos”, acrescentou.

– Victoria Yeo da CNBC contribuiu para este relatório