À medida que os sistemas de IA entram em produção, a fiabilidade e a governação não podem depender de ilusões. Veja como a observabilidade transforma grandes modelos de linguagem (LLMs) em sistemas empresariais auditáveis e confiáveis.

Por que a observabilidade protege o futuro da IA empresarial

A corrida empresarial para implantar sistemas LLM reflete os primeiros dias da adoção da nuvem. Os executivos adoram a promessa; a conformidade exige responsabilidade; os engenheiros só querem uma estrada pavimentada.

No entanto, por baixo do entusiasmo, a maioria dos líderes admite que não consegue rastrear como são tomadas as decisões sobre IA, se ajudaram os negócios ou se quebraram alguma regra.

Tomemos como exemplo um banco da Fortune 100 que implantou um LLM para classificar pedidos de empréstimo. A precisão do benchmark parecia excelente. No entanto, seis meses mais tarde, os auditores descobriram que 18% dos casos críticos foram mal encaminhados, sem um único alerta ou vestígio. A causa raiz não foi preconceito ou dados incorretos. Period invisível. Sem observabilidade, sem responsabilidade.

Se você não consegue observá-lo, não pode confiar nele. E a IA não observada falhará em silêncio.

A visibilidade não é um luxo; é a base da confiança. Sem ele, a IA torna-se ingovernável.

Comece com resultados, não com modelos

A maioria dos projetos corporativos de IA começa com os líderes tecnológicos escolhendo um modelo e, posteriormente, definindo métricas de sucesso. Isso é um retrocesso.

Inverta o pedido:

-

Defina o resultado primeiro. Qual é a meta de negócios mensurável?

-

Desvie 15% das chamadas de cobrança

-

Reduza o tempo de revisão de documentos em 60%

-

Reduza o tempo de tratamento de casos em dois minutos

-

-

Projete a telemetria em torno desse resultado, não em torno de “precisão” ou “pontuação BLEU”.

-

Selecione prompts, métodos de recuperação e modelos que comprovadamente movem esses KPIs.

Numa seguradora world, por exemplo, reenquadrar o sucesso como “minutos poupados por sinistro” em vez de “precisão do modelo” transformou um piloto isolado num roteiro para toda a empresa.

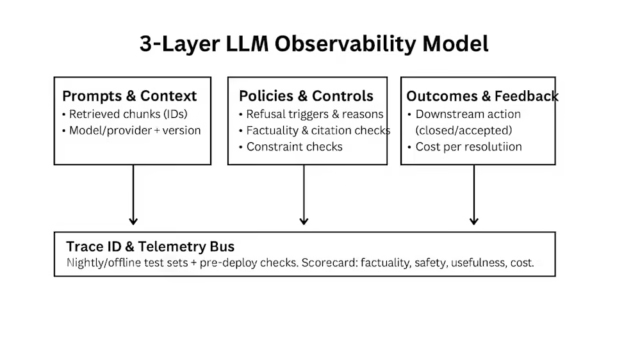

Um modelo de telemetria de 3 camadas para observabilidade LLM

Assim como os microsserviços dependem de logs, métricas e rastreamentos, os sistemas de IA precisam de uma pilha de observabilidade estruturada:

a) Solicitações e contexto: o que aconteceu

-

Registre cada modelo de immediate, variável e documento recuperado.

-

Registre ID do modelo, versão, latência e contagens de tokens (seus principais indicadores de custo).

-

Mantenha um registro de redação auditável mostrando quais dados foram mascarados, quando e por qual regra.

b) Políticas e controles: As grades de proteção

-

Seize resultados de filtros de segurança (toxicidade, PII), presença de citações e acionadores de regras.

-

Armazene os motivos da política e o nível de risco para cada implantação.

-

Vincule as saídas ao cartão do modelo governamental para obter transparência.

c) Resultados e suggestions: Funcionou?

-

Reúna avaliações humanas e edite distâncias de respostas aceitas.

-

Rastreie eventos de negócios posteriores, casos encerrados, documentos aprovados e problemas resolvidos.

-

Meça os deltas de KPI, tempo de chamada, backlog e taxa de reabertura.

Todas as três camadas se conectam por meio de um ID de rastreamento comum, permitindo que qualquer decisão seja repetida, auditada ou melhorada.

Diagrama © SaiKrishna Koorapati (2025). Criado especificamente para este artigo; licenciado para VentureBeat para publicação.

Aplicar disciplina SRE: SLOs e orçamentos de erro para IA

A engenharia de confiabilidade de serviços (SRE) transformou as operações de software program; agora é a vez da IA.

Defina três “sinais de ouro” para cada fluxo de trabalho crítico:

|

Sinal |

SLO desejado |

Quando violado |

|

Fatualidade |

≥ 95% verificado em relação à fonte de registro |

Fallback para modelo verificado |

|

Segurança |

≥ 99,9% passam nos filtros de toxicidade/PII |

Quarentena e revisão humana |

|

Utilidade |

≥ 80% aceito na primeira passagem |

Solicitação/modelo de retreinamento ou reversão |

Se as alucinações ou recusas excederem o orçamento, o sistema roteará automaticamente para avisos mais seguros ou para revisão humana, assim como redireciona o tráfego durante uma interrupção do serviço.

Isto não é burocracia; é a confiabilidade aplicada ao raciocínio.

Construa a fina camada de observabilidade em dois sprints ágeis

Você não precisa de um roteiro de seis meses, apenas foco e dois sprints curtos.

Dash 1 (semanas 1-3): Fundações

-

Registro de immediate controlado por versão

-

Middleware de redação vinculado à política

-

Registro de solicitação/resposta com IDs de rastreamento

-

Avaliações básicas (verificações de PII, presença de citações)

-

UI simples humana no loop (HITL)

Dash 2 (semanas 4-6): Guardrails e KPIs

-

Conjuntos de testes offline (100–300 exemplos reais)

-

Portões políticos para factualidade e segurança

-

Painel leve de rastreamento de SLOs e custos

-

Token automatizado e rastreador de latência

Em 6 semanas, você terá a camada fina que responde a 90% das questões de governança e produtos.

Mfazer avaliações contínuas (e chatas)

As avaliações não devem ser isoladas e heróicas; eles deveriam ser rotineiros.

-

Set up conjuntos de testes de casos reais; atualizar 10–20% mensalmente.

-

Defina critérios de aceitação claros compartilhados pelas equipes de produto e risco.

-

Execute o pacote em cada alteração de immediate/modelo/política e semanalmente para verificações de desvios.

-

Publique um scorecard unificado a cada semana cobrindo factualidade, segurança, utilidade e custo.

Quando as avaliações fazem parte do CI/CD, elas deixam de ser um teatro de conformidade e se tornam verificações operacionais de pulso.

Aplicar hsupervisão humana onde é importante

A automação complete não é realista nem responsável. Casos de alto risco ou ambíguos devem ser encaminhados para análise humana.

-

Encaminhe respostas de baixa confiança ou sinalizadas por políticas para especialistas.

-

Seize cada edição e motivo como dados de treinamento e evidências de auditoria.

-

Alimente o suggestions do revisor em prompts e políticas para melhoria contínua.

Numa empresa de tecnologia da saúde, esta abordagem reduziu os falsos positivos em 22% e produziu um conjunto de dados retreinável e pronto para conformidade em semanas.

Ccontrole por meio do design, não da esperança

Os custos do LLM crescem de forma não linear. Orçamentos não vão salvar você, a arquitetura vai.

-

A estrutura solicita que as seções determinísticas sejam executadas antes das generativas.

-

Compacte e reclassifique o contexto em vez de descartar documentos inteiros.

-

Armazene em cache consultas frequentes e memorize os resultados da ferramenta com TTL.

-

Rastreie a latência, a taxa de transferência e o uso de token por recurso.

Quando a observabilidade abrange tokens e latência, o custo se torna uma variável controlada, e não uma surpresa.

O handbook de 90 dias

Dentro de 3 meses após a adoção dos princípios observáveis de IA, as empresas deverão ver:

-

1–2 assistências de IA de produção com HITL para casos extremos

-

Conjunto de avaliação automatizada para pré-implantação e execuções noturnas

-

Scorecard semanal compartilhado entre SRE, produto e risco

-

Rastreamentos prontos para auditoria vinculando prompts, políticas e resultados

Em um cliente da Fortune 100, essa estrutura reduziu o tempo de incidentes em 40% e alinhou roteiros de produtos e conformidade.

Aumentando a confiança por meio da observabilidade

IA observável é como você transforma a IA de experimento em infraestrutura.

Com telemetria clara, SLOs e ciclos de suggestions humano:

-

Os executivos ganham confiança apoiada em evidências.

-

As equipes de conformidade obtêm cadeias de auditoria reproduzíveis.

-

Os engenheiros iteram com mais rapidez e enviam com segurança.

-

Os clientes experimentam uma IA confiável e explicável.

A observabilidade não é uma camada complementar, é a base para a confiança em escala.

SaiKrishna Koorapati é líder em engenharia de software program.

Leia mais de nossos escritores convidados. Ou considere enviar sua própria postagem! Veja nossas diretrizes aqui.